App要检测孩子手机里的暴露照片,说是避免恋童癖。网友:那App员工岂不都能看到?(组图)

如今,随着智能手机和社交媒体的发展,人们的生活变得更加丰富多彩,但同时也要注意风险。

尤其对于孩子来说,有时可能会被网络上的恋童癖盯上。

近日,日本一家初创公司Smartbooks,正在开发一款App。

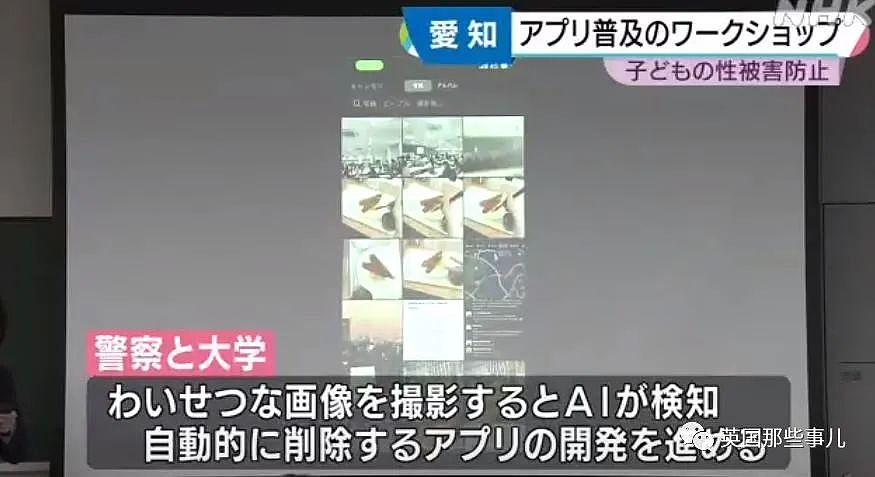

通过人工智能,这款App可以自动识别暴露的生殖器、小腹及胸部的照片。

一旦检测到暴露照片,就会被App删除。

同时,它还会向未成年人的监护人发送警报,告知他们,孩子拍了相关照片。

目前,这款App正处于测试阶段。

开发过程中,日本爱知县藤田医科大学和该县中村警察局也提供了帮助。

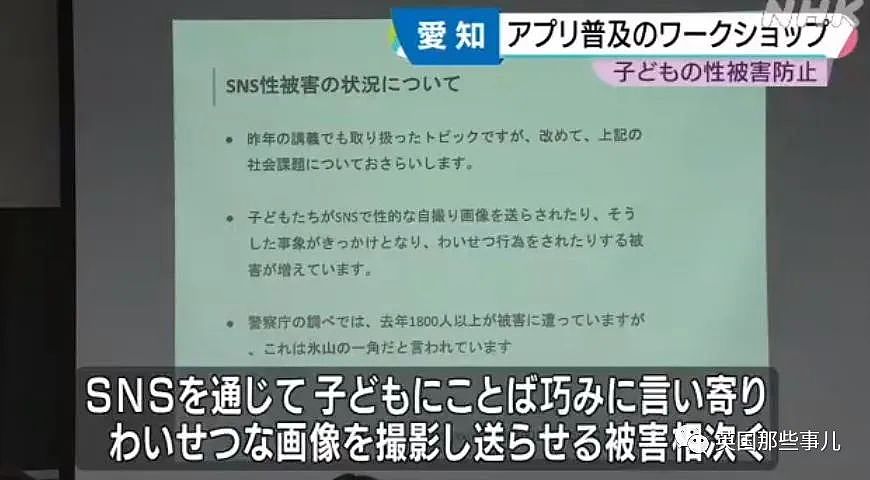

疫情期间,儿童性虐待问题引起了越来越多的关注。

联合国儿童基金会和世界卫生组织向家长发出警告:

随着孩子们长时间居家隔离,玩手机的时间变长,可能面临更多的网络风险。

日本警方公布的数据显示,2021年,日本有1811名儿童成为社交媒体犯罪的受害者,创下历史最高纪录。

这些案件中,约有三分之一违反了日本关于“儿童色情”的法律,其中包括引诱或逼迫儿童自拍裸体的情况。

初创公司Smartbooks的联合创始人Naoto Tomita表示,正在开发的这款App,可以防止未成年人发送暴露的照片。

“有父母说,很犹豫要不要给孩子买智能手机,因为担心孩子们面临未知的网络风险。因此他们迫切需要一些保护措施。”

负责开发的公司,将这款App称为“Kodomamo”,在日语中是“孩子”和“保护”这两个词的组合。

将这款App下载到孩子的手机上,授予访问照片的权限即可。

然后,App将扫描每张照片,并检测是否有暴露的照片。

开发者方面还考虑设计一项功能,就是只有经过父母许可的情况下,孩子才能删除这款App。

预计在今年年底前,这款App将免费对外开放。

为防恋童癖,主动做出预防举措,虽然出发点是好的,但这款App同样引发网友的担忧:

“要是加入开发团队,就能随意看初高中生的照片了?”

“这个App,会把孩子摄影数据都存储起来吧?

那么管理人员想看的话就随便看了。

这样的话也是蛮吓人的。”

“孩子也是有人格的。

如果自己思考的内容,暴露在父母和警察面前,想想都觉得可怕。”

“这要是西洋绘画的话,比如《维纳斯的诞生》,会被通知父母吗?”

“作为AI的学习数据,需要准备大量的类似照片吧,那怎么收集学习数据呢?

这感觉有点本末倒置吧。”

“这么担心的话,还不如关掉孩子手机的摄像功能,不就好了……”

+61

+61 +86

+86 +886

+886 +852

+852 +853

+853 +64

+64